什么是robots 文件,如何书写robots文件

1、什献垴淄睬么是robots协议? robots协议(也称为爬虫协议、机器人协议等)的全称是“网络爬虫排除标准”(Robots Exclusion Pr泠贾高框otocol),网站通过robots协议告诉搜索引擎哪些页面可以抓取,哪些页面不能抓取。robots协议的本质是网站和搜索引擎爬虫的沟通方式,用来指导搜索引擎更好地抓取网站内容,更好的保护用户的隐私和版权信息。 大家记住,如果站内没有robots.txt文件,则表明蜘蛛可以任意抓取网站的文件。对于我们seo网站优化来说并不是所有文件都需要让蜘蛛抓取的。例如一些不重要的文件,或者网站的死链接,我们就需要使用robots.txt来屏蔽掉,不让他抓取。

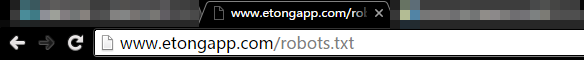

2、robots.txt文件存放在网站的什么地方robots.txt文件存放在我们网站的根目录下,我们如何检测站点里面有没有robots.txt文件,我们只需要在网站的根域名后面输入robots.txt如图所示

3、robots.txt文件书写规则:• User-agent: 蜘蛛名称• Disallow: 内容名称 (禁止抓取的内容)• Allow:内容名称(允许抓取的内容)

声明:本网站引用、摘录或转载内容仅供网站访问者交流或参考,不代表本站立场,如存在版权或非法内容,请联系站长删除,联系邮箱:site.kefu@qq.com。

阅读量:71

阅读量:32

阅读量:63

阅读量:59

阅读量:51