神经网络如何识别视频

1、首先,是一维情痔辏哔刂景,以分类为例,当要分类正数、负数、零,三类的时候,一维空间的直线可以找到两个超平面,比当前空间低一维的子空间。当酡箔挝棍前空间是平面的话,超平面就是点分割这三类。但面对像分类奇数和偶数无法找到可以区分它们的点的时候,我们借助 x % 2除2取余的转变,把x变换到另一个空间下来比较0和非0,从而分割奇偶数。

2、然后,是二维情景,平面的四个象限也是线性可分。但下图的红蓝两条线就无法找到一超平面去分割。神经网络的解决方法依旧是转换到另外一个空间下,用的是所说的5种空间变换操作。比如下图就是经过放大、平移、旋转、扭曲原二维空间后,在三维空间下就可以成功找到一个超平面分割红蓝两线同SVM的思路一样。

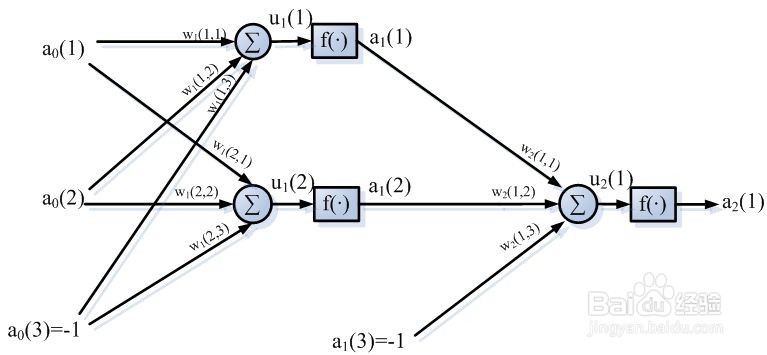

3、其次,所谓监督学习就是给予神经网络网络大量的训陇擦梆疼练例子,让网络从训练例子中学会如何变换空间。每一层的权重 W 就控制着如何变换空间,我们最终需要的也就是训练好的神经网络的所有层的权重矩阵。这里有非常棒的可视化空间变换Demo,一定要打开尝试并感受这种扭曲过程。 更多内容请看Neural Networks, Manifolds, and Topology.

4、其次,线性可分视角,神经网络的学习就是学习如何利用矩阵的线性变换加激活函数的非线性变换,将原始输入空间投向线性可分/稀疏的空间去分类/回归。增加节点数:增加维度,即增加线性转换能力。增加层数:增加激活函数的次数,即增加非线性转换次数。

5、其次,物理视角物质组成,类比回想由碳氧原子通过不同组合形成若干分子的例子。若从分子层面继续迭代这种组合思想,可以形成DNA,细胞,组织,器官,最终可以形成一个完整的人。

6、最后,继续迭代还会有家庭,国家等。这种现象在身边随处可见。并且原子的内部结构与太阳系又惊人的相似。不同层级之间都是以类似的几种规则再不断形成新物质。也可能听过分形学这三个字,可通过观看从1米到150亿光年来感受自然界这种层级现象的普遍性。